研究人員發現了智慧聊天機器人的明顯缺點。儘管人工智慧模型隨著進步可以預見地變得更加準確,但它們也更有可能(錯誤地)回答超出其能力的問題,而不是說「我不知道」。而促使他們這樣做的人更有可能將他們自信的幻覺視為表面價值,從而產生自信的錯誤訊息的涓滴效應。 西班牙巴倫西亞理工大學教授何塞·埃爾南德斯-奧拉洛表示:“現在他們幾乎回答了所有問題。” 自然。 “這意味著更正確,但也更不正確。”計畫負責人埃爾南德斯-奧拉洛與西班牙巴倫西亞人工智慧研究所的同事一起進行了這項研究。 團隊研究了三個LLM系列,包括OpenAI的GPT系列、Meta的LLaMA和開源的BLOOM。他們測試了每個模型的早期版本,並轉向更大、更先進的版本,但不是當今最先進的版本。例如,團隊從OpenAI 相對原始的GPT-3 ada 模型開始,並測試了直至2023 年3 月發布的GPT-4 的迭代。在研究中。我很好奇最新型號是否仍然保持這種趨勢。 研究人員用數千個有關「算術、字謎、地理和科學」的問題測試了每個模型。他們還測試了人工智慧模型轉換資訊的能力,例如按字母順序排列清單。團隊根據感知的難度對提示進行排名。 數據顯示,隨著模型的發展,聊天機器人的錯誤答案比例(而不是完全迴避問題)增加。因此,人工智慧有點像教授,隨著他掌握更多學科,他越來越相信自己對所有學科都有黃金答案。 使事情變得更加複雜的是人類提示聊天機器人並閱讀他們的答案。研究人員要求志願者對人工智慧機器人答案的準確性進行評級,他們發現他們「經常錯誤地將不準確的答案分類為準確的答案」。被志願者誤認為是正確的錯誤答案的範圍通常在 10% 到 40% 之間。 「人類無法監督這些模型,」埃爾南德斯-奧拉洛總結道。 研究團隊建議人工智慧開發人員開始提高簡單問題的效能,並對聊天機器人進行程式設計以拒絕回答複雜的問題。…

Tag: 查特普特

OpenAI 技術長 Mira Murati 即將離開公司

OpenAI 技術長 Mira Murati 於週三辭職,稱她希望「有時間和空間進行自己的探索」。 Murati 是 ChatGPT 背後公司的三名高管之一,去年,當董事會成員為首席執行官 Sam Altman 的命運而苦苦掙扎時,她曾短暫擔任該公司的領導者。 她在 X 上發布給 OpenAI 員工的消息中寫道:“離開一個人所珍惜的地方從來都不是一個理想的時機,但現在感覺就是對的。” Altman 在回覆 Murati…

OpenAI 的新 o1 模型故意變慢

OpenAI 推出了名為 o1 的最新人工智慧模型,該公司聲稱,該模型可以比其前身更有效地執行複雜的推理任務。此次發布之際,OpenAI 在開發更複雜的人工智慧系統方面面臨日益激烈的競爭。 OpenAI 在其網站上表示,O1 接受的培訓是「在問題做出回應之前花更多時間思考問題,就像人一樣」。 「透過訓練, [the models] 學習完善他們的思考過程,嘗試不同的策略,並認識到他們的錯誤。軟體開發人員將使用該模型來產生數學公式。 目前的人工智慧系統本質上是自動完成的更高級版本,透過統計數據產生回應,而不是透過問題實際“思考”,這意味著它們並不像看起來那樣“智能”。當 Engadget 試圖讓 ChatGPT 和其他人工智慧聊天機器人來解決 紐約時報 例如,拼字比賽,他們摸索並產生了荒謬的結果。 該公司聲稱,透過…

AI運算還需要多少水和電力?科技公司不想讓你知道

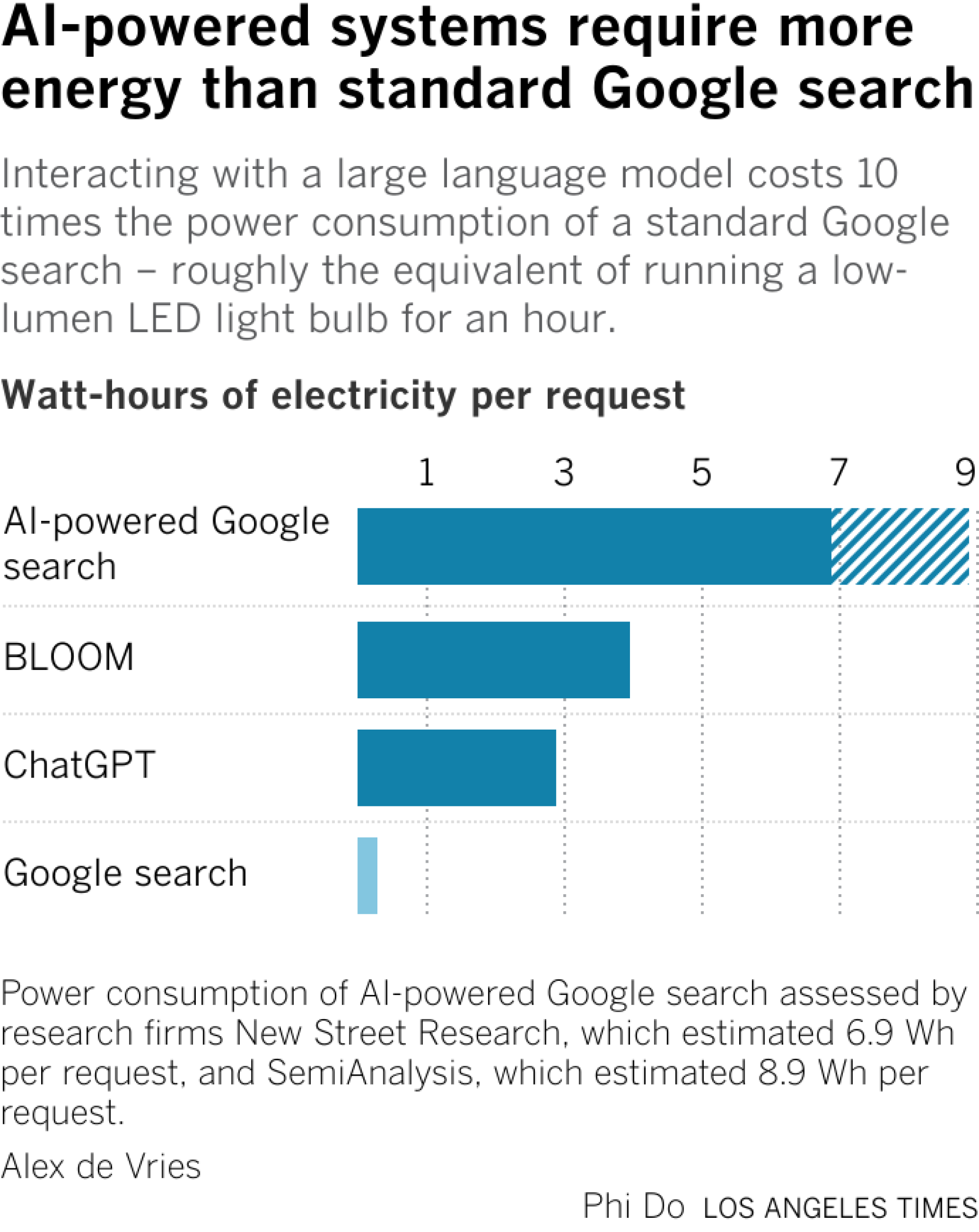

每當有人使用 ChatGPT 寫文章、創建圖像或建議他們計劃一天時,環境都會付出代價。 據估計,使用人工智慧的聊天機器人進行查詢所需的電力至少是 Google 上標準搜尋的 10 倍。 如果所有谷歌搜尋都同樣使用生成式人工智慧,它們消耗的電力可能與愛爾蘭大小的國家一樣多, 亞歷克斯·德弗里斯計算是 Digiconomist 的創辦人,該網站旨在揭露數位趨勢的意外後果。 然而,使用 ChatGPT 或其他人工智慧應用程式的人無法知道他們的問題在科技公司龐大的資料中心處理時會消耗多少電力。 德弗里斯表示,人工智慧技術對能源需求的飆升無疑將要求全球燃燒更多導致氣候變暖的石油、天然氣和煤炭。 「即使我們設法為人工智慧提供再生能源,我們也必須意識到這些能源的供應有限,因此我們將在其他地方使用更多的化石燃料,」他說。 “這的最終結果是更多的碳排放。” AI也渴求水。 ChatGPT…